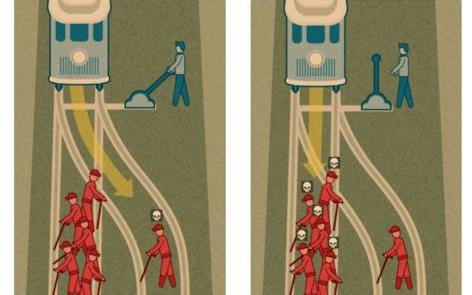

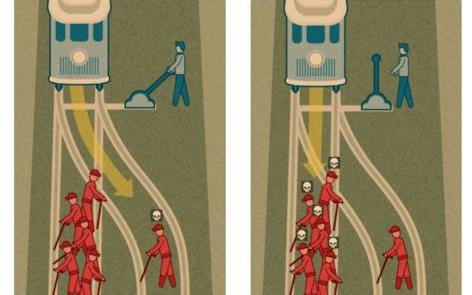

你可能對有軌電車的問題并不陌生:一輛失控的有軌電車正沿著軌道沖下。軌道前面有五名工人。如果電車沖過去,他們肯定會被撞死的。但你可以用操縱桿將電車轉向相鄰的軌道,但軌道上也有一名工人。如果電車沖過去,他也會被撞死。你是讓電車改變軌道殺死一個人,還是什么都不做,讓它殺死五個人?

這是電車謎題最著名的版本,是20世紀70年代普及的哲學思想實驗。還有其他變體:例如,你愿意把一個胖子推下橋,讓電車停下來,而不是殺死更瘦的工人嗎?電車謎題除了是一種哲學實驗外,還被用作心理學實驗的工具。最近,人們將其視為衡量自動駕駛汽車的道德標準。自動駕駛汽車應該優先保護行人還是乘客?老人和孩子相比怎么樣?如果一輛汽車能夠獲得有關事故的信息,它是否應該利用這些數據做出決定?有軌電車問題在自動駕駛汽車領域已經很流行。事實上,麻省理工學院的工程師已經建立了一項名為“道德機器”的測試,記錄人們對自動駕駛汽車在各種條件下應該如何反應的看法。然而,要理解目前存在電車問題的自動駕駛汽車是有問題的。它在解決自動駕駛汽車或工人的道德問題方面做得非常糟糕。將其用于這些目的,特別是作為工程或政策制定中的答案或參考,將使機器倫理變得不完整或更加危險。哲學家朱迪斯·賈維斯·湯姆森于1976年創造了“電車謎題”。然而,這一觀點最早是由另一位哲學家菲利帕·富特在1967年發表的論文《墮胎與教義的雙重影響》中提出的。他認為,人們的意圖和他們所能預見的是不同的。福特以墮胎為例。當外科醫生對孕婦進行子宮切除術時,他可以預見嬰兒的死亡。他應該這樣做嗎?與此同時,一名外科醫生為了挽救母親的生命,終止了胎兒的生命。應該這樣做嗎?盡管案例非常相似,但最終得出的道德結論并不相同。福特提出了許多相關的場景,其中之一就是現在著名的有軌電車問題。另一種假設是,暴徒威脅說,如果法官不處決一個無辜的人,他們會進行報復,殺死更多的人。法官應該怎么做?這似乎是一個電車問題,在或多或少的死亡之間做出選擇。然而,福特寫道,大多數支持電車運營商殺害工人的人也會因陷害無辜者而感到震驚。她得出的結論是,一個人所做的和一個人被允許做的是有區別的。特別是,福特寫道,“避免傷害和提供幫助之間的區別真的很重要。”福特的短文為當代讀者提供了一種更微妙的方式來思考涉及自動駕駛汽車的道德場景,而不僅僅是分析所謂的電車問題。在某種程度上,這是因為福特遵循了亞里士多德之后被稱為道德和倫理的傳統。然而,遵守道德準則并不會導致目前大多數關于自動駕駛汽車的爭論。相反,對最終結果是自動駕駛汽車的社會的擔憂是最令人擔憂的。在道德哲學中,這種不同于道德倫理的方法被稱為結果主義。后果主義者,包括最著名的功利主義者,首先關注的是行為的結果和后果。這種功利主義思想深深植根于自動駕駛汽車的修辭中。甚至在自動駕駛汽車的倡導者開始決定車禍發生時撞誰之前,它就已經存在了。推動自動駕駛汽車大規模采用的一個常見原因是,它們可以極大地提高道路安全。2016年,美國有37000多人死于車禍。由于94%以上的車禍是由司機的錯誤引起的,用可靠的機器取代容易犯錯的人顯然是社會的凈利益。問題是,專注于結果可能會讓人們對自動駕駛汽車的優點和缺點視而不見。正如福特所指出的,工人面臨電車問題和法官面臨暴徒威脅的道德場景是不同的。因此,自動駕駛汽車以人為代價的同樣結果可能會帶來c……

完全不同的道德、法律和民事后果。最近,亞利桑那州坦佩市一輛優步自動駕駛汽車撞死了49歲的騎自行車過街的行人伊萊恩·赫茨伯格。在我寫了一篇關于這場車禍可能產生的法律影響的文章后,一些讀者以功利的嘲諷回應。畢竟,2015年美國有5376名行人被汽車撞死,新聞媒體不會把每個人都當作特例來報道。很快,自動駕駛汽車可以減少或消除行人死亡。如果你使用電車謎題的術語,軌道代表的是時間,而不是空間。一個人的死仍然是一場悲劇。但如果她的死意味著在防止數千人死亡方面取得進展,那么這也許是合理的。問題是,這種立場假設赫茲伯格的死亡與普通汽車造成的數千人死亡完全相同。從統計數據來看,這可能是真的,但從道德上講,這不一定是真的。未來,如果自動駕駛汽車能夠有效運行,就可以防止像Tempe這樣的車禍。傳感器和計算機對周圍環境的反應比人類更好,行為也更理性。隨著優步車禍的細節逐漸浮出水面,一些專家得出結論,這起車禍本可以避免。此外,優步的自動駕駛汽車似乎沒有達到公司的目標,即在3月份發生車禍時,每13英里只需要人工干預。與此同時,谷歌的兄弟公司Waymo聲稱,其自動駕駛汽車在沒有人為干預的情況下平均可以行駛5600英里。然后,在亞利桑那州的道路上,Waymo的自動駕駛汽車和優步的自動駕駛車輛之間的差異可能比人工駕駛汽車和計算機駕駛汽車之間的差異更重要。然而,為了吸引更多的公司到亞利桑那州學習和測試,從而促進就業。亞利桑那州州長道格·杜西允許所有此類汽車在沒有重大監督的情況下進行道路測試。這些條件的存在決定了這個問題不能從電車問題的角度來考慮。如果你想問優步是應該撞上赫茲伯格還是突然轉向(以使安全人員處于危險之中并避免行人被撞),你需要假設優步的車輛可以首先看到行人并做出相應的反應。有必要假設這種能力是可靠的,并保證它相當于一種機械行為,就像切換有軌電車軌道一樣。這個背景在坦佩的車禍中消失了。然而,福特已經預料到她的案件缺乏背景。“在現實生活中,”她寫道,“很難確定電車轉彎后站在軌道上的人會被殺。也許他會在車身側面找到一個立足點,并在車輛經過時緊緊抓住它。”解決這種無限可能性的一種方法是運行無限的電車問題,并從公眾對這些問題的反應中收集模式。這是麻省理工學院對待道德機器的方法,與機器學習系統的最佳工作方式相匹配:使用大型數據集。但在最合適的道德背景下考慮具體問題還有另一種方法。碰巧的是,福特還提出了一個不同的例子,這個例子與坦佩實際發生的事情有更多的共同點,而不是電車問題。想象一下,醫院里有五個病人。使用某種氣體可以挽救他們的生命,但使用這種氣體會向另一個無法移動的患者的房間釋放致命的煙霧。在這種情況下,問題與經典的有軌電車問題相同。然而,對許多人來說,結果并不那么明顯。這只是因為預期效果和可預見效果的不同,也因為避免傷害所產生的道德欲望有不同的運作方式。在電車問題中,司機面臨著兩種類似傷害之間的矛盾,別無選擇。但在醫院發生煤氣事故的情況下,醫生面臨著提供幫助和造成傷害之間的矛盾。事實上,優步的處境更為艱難,因為所有參與者,無論是汽車制造公司、駕駛它的司機還是監管它的政府,似乎都不完全理解車輛現在(而不是未來)造成損壞的能力。這使得優步事故的道德背景不再是減少未來的車禍,更多的是政府監管、公司信息披露和交通政策的現狀。然而,這些話題遠不如失控的電車吸引人。如果這是技術人員、公民和政策制定者真正想要的道德哲學的先例。那么,他們最好以優步的車禍為例……

道德運氣,這是由哲學家托馬斯·納格爾提出的。有一個經典的例子:一個醉漢晚上開車回家。盡管他喝醉了,但他終于到達了目的地,沒有發生任何意外。然后想象另一個場景。一名男子在同樣的情況下開車,但他不小心撞死了一名過馬路的兒童。人們似乎很自然地認為后者比前者更應受到譴責,但他們都采取了同樣的自愿行動。唯一的區別是結果。從這個角度來看,優步帶來的車禍并不代表一種價值中立,更不代表所謂的正義:在自動駕駛汽車得到有效部署的世界上,犧牲一名行人來確保更多人的安全。相反,它強調了這樣一個事實,即積極的結果——更安全的汽車、更安全的行人等——很容易成為自動駕駛汽車道德運氣的一部分,因為它們沒有犯下應受譴責的行為。當然,現在不行了。道德運氣也為自動駕駛汽車開辟了其他考慮方式。就自動駕駛汽車而言,自愿行動更難確定。優步司機知道并理解他們行為的所有后果嗎?假設人類駕駛員可以干預他們正在觀察的機器的操作,而不是主動操作機器,這合理嗎?當亞利桑那州明確邀請自動駕駛汽車在實際道路上進行實驗測試時,優步是否也應該受到譴責?所有這些問題現在都在亞利桑那州和其他地方被問到了。但對伊萊恩·赫茨伯格來說,這只是一種冷冰冰的安慰。這一切的意義并不在于指責或贊揚最近優步車禍中的具體參與者。它也不是為了慶祝或哀嘆自動駕駛汽車的未來。相反,它表明,無論是現在還是未來,解決和處理自動駕駛汽車都需要更高的道德修養。道德不是將簡單的計算應用于任何問題,也不是將人類對一個模型案例的一整套意見應用于整個模型下的一個示例問題。事實上,采取這些立場可以從一開始就得出功利的結論。當工程師、評論家、記者或普通人將電車問題視為一個非常適合(也許是為了方便)思考自動駕駛汽車的問題時,他們拒絕考慮這些機器操作更復雜的道德條件。對于哲學家來說,思想實驗提供了一種考慮未知結果或重新考慮已接受結果的方法。但它們只是思考的工具,而不是現成的行動指南。特別是,有軌電車問題的流行讓人們錯誤地認為自動駕駛汽車是一種現有的、可靠的、同質的技術,因此可以提出甚至回答關于他們假設的道德行為的抽象問題。然而,這需要幾年的時間才能實現。與此同時,公民、政府、汽車制造商和科技公司必須就今天和明天自動駕駛汽車可能帶來的道德后果提出更困難和復雜的問題。是時候在電車撞死所有人之前踩剎車了。你可能對有軌電車的問題并不陌生:一輛失控的有軌電車正沿著軌道沖下。軌道前面有五名工人。如果電車沖過去,他們肯定會被撞死的。但你可以用操縱桿將電車轉向相鄰的軌道,但軌道上也有一名工人。如果電車沖過去,他也會被撞死。你是讓電車改變軌道殺死一個人,還是什么都不做,讓它殺死五個人?

這是電車謎題最著名的版本,是20世紀70年代普及的哲學思想實驗。還有其他變體:例如,你愿意把一個胖子推下橋,讓電車停下來,而不是殺死更瘦的工人嗎?電車謎題除了是一種哲學實驗外,還被用作心理學實驗的工具。最近,人們將其視為衡量自動駕駛汽車的道德標準。自動駕駛汽車應該優先保護行人還是乘客?老人和孩子相比怎么樣?如果一輛汽車能夠獲得有關事故的信息,它是否應該利用這些數據做出決定?有軌電車問題在自動駕駛汽車領域已經很流行。事實上,麻省理工學院的工程師已經建立了一項名為“道德機器”的測試,記錄人們對自動駕駛汽車在各種條件下應該如何反應的看法。然而,理解當前的自我博士是有問題的……

電車問題。它在解決自動駕駛汽車或工人的道德問題方面做得非常糟糕。將其用于這些目的,特別是作為工程或政策制定中的答案或參考,將使機器倫理變得不完整或更加危險。哲學家朱迪斯·賈維斯·湯姆森于1976年創造了“電車謎題”。然而,這一觀點最早是由另一位哲學家菲利帕·富特在1967年發表的論文《墮胎與教義的雙重影響》中提出的。他認為,人們的意圖和他們所能預見的是不同的。福特以墮胎為例。當外科醫生對孕婦進行子宮切除術時,他可以預見嬰兒的死亡。他應該這樣做嗎?與此同時,一名外科醫生為了挽救母親的生命,終止了胎兒的生命。應該這樣做嗎?盡管案例非常相似,但最終得出的道德結論并不相同。福特提出了許多相關的場景,其中之一就是現在著名的有軌電車問題。另一種假設是,暴徒威脅說,如果法官不處決一個無辜的人,他們會進行報復,殺死更多的人。法官應該怎么做?這似乎是一個電車問題,在或多或少的死亡之間做出選擇。然而,福特寫道,大多數支持電車運營商殺害工人的人也會因陷害無辜者而感到震驚。她得出的結論是,一個人所做的和一個人被允許做的是有區別的。特別是,福特寫道,“避免傷害和提供幫助之間的區別真的很重要。”福特的短文為當代讀者提供了一種更微妙的方式來思考涉及自動駕駛汽車的道德場景,而不僅僅是分析所謂的電車問題。在某種程度上,這是因為福特遵循了亞里士多德之后被稱為道德和倫理的傳統。然而,遵守道德準則并不會導致目前大多數關于自動駕駛汽車的爭論。相反,對最終結果是自動駕駛汽車的社會的擔憂是最令人擔憂的。在道德哲學中,這種不同于道德倫理的方法被稱為結果主義。后果主義者,包括最著名的功利主義者,首先關注的是行為的結果和后果。這種功利主義思想深深植根于自動駕駛汽車的修辭中。甚至在自動駕駛汽車的倡導者開始決定車禍發生時撞誰之前,它就已經存在了。推動自動駕駛汽車大規模采用的一個常見原因是,它們可以極大地提高道路安全。2016年,美國有37000多人死于車禍。由于94%以上的車禍是由司機的錯誤引起的,用可靠的機器取代容易犯錯的人顯然是社會的凈利益。問題是,專注于結果可能會讓人們對自動駕駛汽車的優點和缺點視而不見。正如福特所指出的,工人面臨電車問題和法官面臨暴徒威脅的道德場景是不同的。因此,以人為代價的自動駕駛汽車的同樣結果可能會帶來完全不同的道德、法律和民事后果。最近,亞利桑那州坦佩市一輛優步自動駕駛汽車撞死了49歲的騎自行車過街的行人伊萊恩·赫茨伯格。在我寫了一篇關于這場車禍可能產生的法律影響的文章后,一些讀者以功利的嘲諷回應。畢竟,2015年美國有5376名行人被汽車撞死,新聞媒體不會把每個人都當作特例來報道。很快,自動駕駛汽車可以減少或消除行人死亡。如果你使用電車謎題的術語,軌道代表的是時間,而不是空間。一個人的死仍然是一場悲劇。但如果她的死意味著在防止數千人死亡方面取得進展,那么這也許是合理的。問題是,這種立場假設赫茲伯格的死亡與普通汽車造成的數千人死亡完全相同。從統計數據來看,這可能是真的,但從道德上講,這不一定是真的。未來,如果自動駕駛汽車能夠有效運行,就可以防止像Tempe這樣的車禍。傳感器和計算機對周圍環境的反應比人類更好,行為也更理性。隨著優步車禍的細節逐漸浮出水面,一些專家得出結論,這起車禍本可以避免。此外,優步的自動駕駛汽車似乎沒有達到公司的目標,即在3月份發生車禍時,每13英里只需要人工干預。與此同時,谷歌的兄弟公司Waymo聲稱,其自動駕駛汽車在沒有人為干預的情況下平均可以行駛5600英里……

然后,在亞利桑那州的道路上,Waymo的自動駕駛汽車和優步的自動駕駛車輛之間的差異可能比人工駕駛汽車和計算機駕駛汽車之間的差異更重要。然而,為了吸引更多的公司到亞利桑那州學習和測試,從而促進就業。亞利桑那州州長道格·杜西允許所有此類汽車在沒有重大監督的情況下進行道路測試。這些條件的存在決定了這個問題不能從電車問題的角度來考慮。如果你想問優步是應該撞上赫茲伯格還是突然轉向(以使安全人員處于危險之中并避免行人被撞),你需要假設優步的車輛可以首先看到行人并做出相應的反應。有必要假設這種能力是可靠的,并保證它相當于一種機械行為,就像切換有軌電車軌道一樣。這個背景在坦佩的車禍中消失了。然而,福特已經預料到她的案件缺乏背景。“在現實生活中,”她寫道,“很難確定電車轉彎后站在軌道上的人會被殺。也許他會在車身側面找到一個立足點,并在車輛經過時緊緊抓住它。”解決這種無限可能性的一種方法是運行無限的電車問題,并從公眾對這些問題的反應中收集模式。這是麻省理工學院對待道德機器的方法,與機器學習系統的最佳工作方式相匹配:使用大型數據集。但在最合適的道德背景下考慮具體問題還有另一種方法。碰巧的是,福特還提出了一個不同的例子,這個例子與坦佩實際發生的事情有更多的共同點,而不是電車問題。想象一下,醫院里有五個病人。使用某種氣體可以挽救他們的生命,但使用這種氣體會向另一個無法移動的患者的房間釋放致命的煙霧。在這種情況下,問題與經典的有軌電車問題相同。然而,對許多人來說,結果并不那么明顯。這只是因為預期效果和可預見效果的不同,也因為避免傷害所產生的道德欲望有不同的運作方式。在電車問題中,司機面臨著兩種類似傷害之間的矛盾,別無選擇。但在醫院發生煤氣事故的情況下,醫生面臨著提供幫助和造成傷害之間的矛盾。事實上,優步的處境更為艱難,因為所有參與者,無論是汽車制造公司、駕駛它的司機還是監管它的政府,似乎都不完全理解車輛現在(而不是未來)造成損壞的能力。這使得優步事故的道德背景不再是減少未來的車禍,更多的是政府監管、公司信息披露和交通政策的現狀。然而,這些話題遠不如失控的電車吸引人。如果這是技術人員、公民和政策制定者真正想要的道德哲學的先例。那么,他們最好把優步的車禍作為道德運氣的一個例子,這是哲學家托馬斯·納格爾提出的。有一個經典的例子:一個醉漢晚上開車回家。盡管他喝醉了,但他終于到達了目的地,沒有發生任何意外。然后想象另一個場景。一名男子在同樣的情況下開車,但他不小心撞死了一名過馬路的兒童。人們似乎很自然地認為后者比前者更應受到譴責,但他們都采取了同樣的自愿行動。唯一的區別是結果。從這個角度來看,優步帶來的車禍并不代表一種價值中立,更不代表所謂的正義:在自動駕駛汽車得到有效部署的世界上,犧牲一名行人來確保更多人的安全。相反,它強調了這樣一個事實,即積極的結果——更安全的汽車、更安全的行人等——很容易成為自動駕駛汽車道德運氣的一部分,因為它們沒有犯下應受譴責的行為。當然,現在不行了。道德運氣也為自動駕駛汽車開辟了其他考慮方式。就自動駕駛汽車而言,自愿行動更難確定。優步司機知道并理解他們行為的所有后果嗎?假設人類駕駛員可以干預他們正在觀察的機器的操作,而不是主動操作機器,這合理嗎?當亞利桑那州明確邀請自動駕駛汽車在實際道路上進行實驗測試時,優步是否也應該受到譴責?所有這些問題現在都在亞利桑那州和其他地方被問到了。但對伊萊恩·赫茨伯格來說,這只是一種冷冰冰的安慰。s……

這一切的重要性并不在于指責或贊揚最近優步車禍中的具體參與者。它也不是為了慶祝或哀嘆自動駕駛汽車的未來。相反,它表明,無論是現在還是未來,解決和處理自動駕駛汽車都需要更高的道德修養。道德不是將簡單的計算應用于任何問題,也不是將人類對一個模型案例的一整套意見應用于整個模型下的一個示例問題。事實上,采取這些立場可以從一開始就得出功利的結論。當工程師、評論家、記者或普通人將電車問題視為一個非常適合(也許是為了方便)思考自動駕駛汽車的問題時,他們拒絕考慮這些機器操作更復雜的道德條件。對于哲學家來說,思想實驗提供了一種考慮未知結果或重新考慮已接受結果的方法。但它們只是思考的工具,而不是現成的行動指南。特別是,有軌電車問題的流行讓人們錯誤地認為自動駕駛汽車是一種現有的、可靠的、同質的技術,因此可以提出甚至回答關于他們假設的道德行為的抽象問題。然而,這需要幾年的時間才能實現。與此同時,公民、政府、汽車制造商和科技公司必須就今天和明天自動駕駛汽車可能帶來的道德后果提出更困難和復雜的問題。是時候在電車撞死所有人之前踩剎車了。

別克將向中國市場投放兩款新車型,分別為插電式混動版及純電動版VELITE6車型,旨在滿足中國國內快速增長的新能源車需求。

1900/1/1 0:00:00在節能減排需求和全球政府的聯合推動下,新能源汽車已成為汽車產業近幾年最大的增長點,在中國尤其如此。2016年,中國汽車產銷突破2800萬輛,連續8年位居全球第一。

1900/1/1 0:00:002018年4月2日,由中國汽車技術研究中心有限公司(下稱“中汽中心”)、日產(中國)投資有限公司、社會科學文獻出版社共同主辦的“2018年新能源汽車藍皮書編寫啟動會”在中國科技會堂召開。

1900/1/1 0:00:004月3日,在浙江省第五批重大產業項目啟動儀式上,游俠汽車作為湖州市近年最大招商項目,同時也是唯一一家新造車企代表進行開工宣貫,宣告游俠超級工廠正式啟動。

1900/1/1 0:00:00占地面積相當于18個足球場、涵蓋城市與鄉村的復雜道路環境、場地設施齊全的北京首個自動駕駛車輛封閉測試場地,位于北京海淀駕校。該測試場是北京自動駕駛車輛正式上路前的標準封閉測試場地。

1900/1/1 0:00:002018年4月3日,電動汽車安全全球技術法規(EVSGTR)宣貫會在北京召開,會議由世界車輛法規協調論壇中國工作委員會(CWP29)秘書處承辦,汽車行業近200名專家參加了會議。

1900/1/1 0:00:00