攝像頭是ADAS的核心傳感器。與毫米波雷達和激光雷達相比,最大的優勢在于識別(物體是汽車還是人,標志牌是什么顏色)。汽車行業對價格敏感,攝像頭硬件的成本相對較低。由于近年來計算機視覺的快速發展,從相機角度切入ADAS感知的初創公司數量也非常可觀。

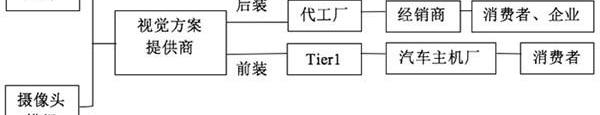

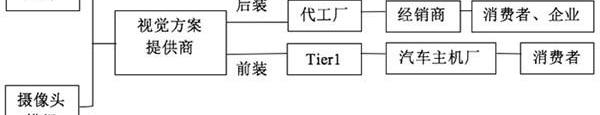

這些初創公司可以統稱為視覺解決方案提供商。他們掌握核心視覺傳感器算法,為下游客戶提供包括車載攝像頭模塊、芯片和軟件算法在內的全套解決方案。在預安裝模式下,視覺解決方案提供商扮演第二級供應商的角色,與Tier1合作為OEM定義產品。在安裝后的模式中,除了提供一套完整的設備外,還有一種出售算法的模式。

本文將分析視覺ADAS的功能、硬件要求和評估標準,并在《[車云報告]ADAS視覺解決方案簡介盤點(第二部分)》中參考Mobileye對國內11家初創公司的產品進行詳細解讀。

視覺ADAS供應鏈系統

首先,視覺ADAS可以實現功能

由于安全記錄和停車的需要,汽車中使用了大量的攝像頭作為行車記錄儀和倒車影像等輔助功能。通常,圖像由安裝在車身各個位置的廣角攝像頭采集,經過校準和算法處理后,生成或拼接圖像形成視圖,以補充駕駛員的視覺盲點,而不涉及車輛控制,因此更注重視頻處理,技術已經成熟并逐漸普及。

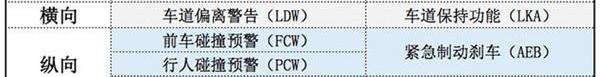

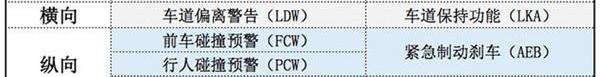

目前,在駕駛輔助功能中,攝像頭可以獨立實現許多功能,并根據自動駕駛的發展規律逐步進化。

這些功能更加強調對輸入圖像的處理,從拍攝的視頻流中提取有效的目標運動信息進行進一步分析,給出預警信息或直接調動控制機制。與視頻輸出功能相比,它強調高速下的實時性能,這部分技術正處于發展的上升期。

第二,視覺ADAS的軟硬件要求

視覺系統ADAS產品由軟件和硬件組成,主要包括攝像頭模塊、核心算法芯片和軟件算法。在硬件方面,應考慮駕駛環境(振動、高低溫等),大前提是滿足車輛法規的要求。

(1) 車載ADAS攝像頭模塊

車載ADAS攝像頭模塊需要定制化開發。為了滿足全天候車輛的需求,當明暗對比度太大(進出隧道)時,通常需要平衡圖像中太亮或太暗(寬動態)的部分。對光敏感(高靈敏度),避免給芯片帶來太大壓力(不要盲目追求高像素)。

攝像頭模塊是基礎。就像一張有著良好基礎的照片一樣,也有美化的空間。在保證拍攝到的圖像足夠的基礎上,該算法可以更好地發揮作用。

此外,在參數方面,ADAS和行車記錄儀對攝像頭有不同的要求。用于行車記錄儀的攝像頭需要看到汽車前部周圍盡可能多的環境信息(后視鏡看著兩個前輪,水平視角約為110度)。ADAS的攝像頭更注重為駕駛預留更多的判斷時間,需要看得更遠。與相機鏡頭的廣角和長焦類似,這兩個參數不可能同時存在,ADAS只能在選擇硬件時進行平衡。

(2) 核心算法芯片

圖像相關算法對計算資源的要求很高,因此芯片的性能也很特殊。如果在算法上疊加深度學習來幫助提高識別率,那么對硬件性能的要求只會增加,主要性能指標是操作速度、功耗和成本。

目前,ADAS中使用的大多數芯片……

eras被外國壟斷,主要供應商有瑞薩電子、ST微電子(ST)、自由規模、亞德諾(ASIC)、德州儀器(TI)、恩智浦、富士通、賽靈思、英偉達等。

ARM、DSP、ASIC、MCU和SOC是軟件編程的嵌入式方案。與嵌入式系統相比,FPGA具有更快的處理速度,因為它直接對硬件進行編程。

GPU和FPGA具有較強的并行處理能力。對于圖片之類的文本,尤其是在使用深度學習算法時,需要多個像素同時計算,FPGA和GPU將具有更多優勢。這兩種芯片的設計思想相似,都是為了處理大量簡單重復的操作而設計的。GPU的性能更強,但能耗更高。由于FPGA的編程和優化是直接在硬件層面進行的,因此能耗會低得多。

因此,FPGA被認為是一種流行的平衡算法和處理速度的方案,尤其是當它用于預安裝并且算法穩定時。FPGA是一個不錯的選擇。但與此同時,FPGA的技術要求也很高。原因是計算機視覺算法是用C語言編寫的,FPGA硬件語言是verilog。這兩種語言是不同的,所以將算法移植到FPGA的人應該有軟件背景和硬件背景。在人才最昂貴的今天,這是一個不小的成本。

目前,可以用于傳統計算機視覺算法的車規芯片有很多選擇,但適合傳統算法和深度學習算法的低功耗、高性能芯片還沒有真正出現。

(3) 算法

ADAS視覺算法的來源是計算機視覺。

傳統的物體計算機視覺識別大致可以分為幾個步驟:圖像輸入、預處理、特征提取、特征分類、匹配和完全識別。

有兩個特殊的地方依賴于專業經驗:第一個是特征提取。識別障礙物時有許多可用的功能,功能設計尤其重要。要判斷前方的障礙物是否是汽車,參考特征可能是汽車的尾燈,也可能是汽車底盤在地面上投射的陰影。二是預處理和后處理。預處理包括輸入圖像的噪聲平滑、對比度增強和邊緣檢測。后處理是指對分類和識別結果候選者進行后處理。

科學研究中的計算機視覺算法模型在應用于實際環境時可能表現不佳。由于科學研究獲得的算法會增加天氣、復雜路況等條件,在現實世界中,除了要注意算法在復雜環境中的性能外,還要考慮算法在各種環境中的魯棒性(穩定性)。

算法的一個重要變化是深度學習的滲透。

深度學習使計算機能夠模擬人類思維的神經網絡,并能夠自行學習和判斷。通過將校準后的原始數據直接輸入計算機,例如選擇一堆異形汽車的圖片,然后將其扔到計算機中,它可以自己學習汽車是什么。這樣,可以省去計算視覺特征提取和預處理的步驟,將感知過程簡化為輸入圖片和輸出結果兩個步驟。

業內一致認為,在感知方面,深度學習將在角落里超越傳統的視覺算法。目前,深度學習的算法模型已經開源,算法種類不多,因此有可能降低閾值,并產生大量優秀的結果。然而,由于缺乏合適的汽車平臺,距離商業化還有很長的路要走。

業界對深度學習在ADAS中的應用的看法是客觀而冷靜的。許多人認為深度學習算法是Blackbox算法,類似于人類感知決策的過程,可以快速輸出結果,因此很難在事故發生后檢查原因。因此,在使用深度學習時應添加理性決策,并將設計劃分為多個塊。

還有一種觀點認為,傳統的計算機視覺算法比我們想象的更智能,它也可以檢測到……中的一些異形車輛……

不斷尋找車輛圖片的相似性和差異性的過程。并且在疊加深度學習算法后,傳統的計算機視覺算法也可以幫助減少深度學習神經網絡的層數,簡化算法。

可以肯定的是,無論哪種算法,數據都是訓練和測試的寶貴資源,而且不是簡單地說越多越好,而是越有效越好(符合實際的汽車環境并確保多樣化)。

(4) 不同的攝像機平臺

單眼和雙目

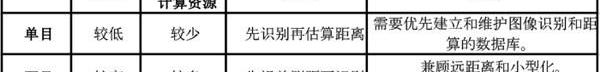

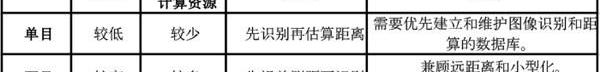

為了完成ADAS任務,視覺方案通常需要實現兩項任務:測距(車輛與前方障礙物之間的距離)和識別(障礙物是什么)。根據汽車攝像頭模塊的不同,目前主流的ADAS攝像頭可以分為單眼和雙目兩種技術路線。

單眼相機的算法思想是先識別后測距:首先通過圖像匹配進行識別,然后根據圖像大小和高度進一步估計障礙物和車輛時間。在識別和估計階段,有必要與已建立的樣本數據庫進行比較。如果你想識別各種汽車,你需要建立一個車型數據庫,如果你想鑒定麋鹿,你需要創建一個麋鹿數據庫。

雙目攝像機的算法是先測距后識別:首先,通過視差直接測量物體和汽車之間的距離,原理與人眼相似。當兩只眼睛看著同一個物體時,會有視差,也就是說,當他們閉上左眼和右眼看物體時,他們會發現感覺位移。這種位移可以進一步測量目標物體的距離。然后,在識別階段,雙目仍然需要使用與單眼相同的特征提取和深度學習算法來進一步識別障礙物。

因為視差越遠,視差就越小。業內有觀點認為,雙目在20米以內具有明顯的測距優勢,在20米以外很難減少視差測距。我們可以使用高像素相機和更好的算法來提高測距性能,這是難點和核心競爭力。

雙目透鏡間距和距離測量是兩個權衡參數。透鏡間距越小,檢測距離越近,透鏡間距越大,檢測距離就越遠。考慮到汽車的美觀性和ADAS的需求,小型遠程雙目產品更受歡迎。

由于增加一個鏡頭會帶來更多的計算量,因此整個相機模塊的性能要求和成本都更高。此外,在兩者的校準工作中,雙目比單眼更為復雜。

此外,選擇雙目方案切入市場并不能完全繞過單眼方案的難度。在第二階段,您仍然需要一個龐大的數據庫并完善算法。

單眼對比

多攝像頭方案

除了一臺雙目望遠鏡外,還有一個由多臺攝像機組成的平臺。在一些方案中,選擇長焦和廣角相機與ADAS主相機配合,兼顧周圍環境和遠處物體檢測。例如,Mobileye方案將在下面介紹。

也有ADAS功能疊加在全景平臺上的情況。例如,對于環視進行車道偏離警告(LDW),與單目實現該功能相比,它具有一定的優勢。在大雨或前方光源強的情況下,前視攝像頭可能看不清車道線,攝像頭可以斜向下看車道線并提供多個角度,基本不受地面水反射的影響,其功能可以比前視攝像頭更穩定。但同時,我們也要考慮在側面沒有大燈的情況下攝像頭的夜間表現。

這些方案與單眼在技術路線上沒有本質區別。它們更多地基于不同的平臺,充分發揮不同類型相機模塊的優勢來分配任務,或者提供更多的視角來解決單眼在一些復雜環境中較弱的情況。

第三,視覺系統ADAS產品測試與評估

目前,還沒有統一的ADAS測試和評估標準……

ard。常規測試通常分為兩個階段:

在算法庫測試中,庫中包含了在各種工況下采集的駕駛場景視頻,并利用庫中的場景視頻測試算法識別率。目前,測試庫由每家公司自行測試,因為集合中使用的傳感器不同,不同企業的測試結果也不具有可比性。

KITTI由德國卡爾斯魯厄理工學院和芝加哥豐田理工學院共同創立,是一個國際權威的機動車輔助駕駛應用技術評估算法評估平臺。目前,一些公司在這個網站上測試算法,結果是公開的。不同公司的運行時間存在差異,因此我們在查看結果排名時不能忽視多個參數的比較。

在實車測試階段,將產品DEMO安裝在車內進行測試,并根據漏報和誤報判斷算法的可靠性,對發現的問題進行反復調試。目前,高質量的實車測試大多由主機廠和零部件供應商控制。精確測量需要激光雷達等設備的幫助,在相互驗證的過程中完成測量,成本略高,測試周期略長。

據業內人士介紹,算法庫測試更多的是用來測試產品70-90分的能力,而實車定量測試必須在90-95分甚至95-98分的差距時進行。目前,ADAS家庭之間的差距在于將分數從90分提高到99分。為了做到這一點,我們必須做大量的實際道路測試,并打磨算法的準確性和穩健性。因此,在某種程度上,在OEM中經歷過Tier1嚴格培訓的解決方案提供商具有更高的產品可靠性,預安裝經驗將成為下一次合作談判的資本。

目前,企業聲稱衡量算法能力的“識別率”指標不能說完全沒有參考價值。前提是,所謂的識別率應該在不同的復雜場景下進行評估,單獨談論識別率指數是沒有意義的,因此需要與其他指標一起考慮。該產品必須確保算法能夠在不同的路況、天氣、車輛類型、不同姿勢的人和不同的車道線下穩定(穩健)工作。

第四,兄弟Mobileye

視聽部門ADAS不得不提到一家以色列公司Mobileye,該公司成立于1999年,2007年推出了第一款產品,并于2014年8月1日在紐約證券交易所上市。公司主要從事汽車行業計算機視覺算法和駕駛員輔助系統芯片技術的研究。攝像頭是ADAS的核心傳感器。與毫米波雷達和激光雷達相比,最大的優勢在于識別(物體是汽車還是人,標志牌是什么顏色)。汽車行業對價格敏感,攝像頭硬件的成本相對較低。由于近年來計算機視覺的快速發展,從相機角度切入ADAS感知的初創公司數量也非常可觀。

這些初創公司可以統稱為視覺解決方案提供商。他們掌握核心視覺傳感器算法,為下游客戶提供包括車載攝像頭模塊、芯片和軟件算法在內的全套解決方案。在預安裝模式下,視覺解決方案提供商扮演第二級供應商的角色,與Tier1合作為OEM定義產品。在安裝后的模式中,除了提供一套完整的設備外,還有一種出售算法的模式。

本文將分析視覺ADAS的功能、硬件要求和評估標準,并在《[車云報告]ADAS視覺解決方案簡介盤點(第二部分)》中參考Mobileye對國內11家初創公司的產品進行詳細解讀。

視覺ADAS供應鏈系統

首先,視覺ADAS可以實現功能

由于安全記錄和停車的需要,汽車中使用了大量的攝像頭作為行車記錄儀和倒車影像等輔助功能。一般來說,圖像都是收集的……

通過安裝在車身各個位置的廣角攝像頭,經過校準和算法處理,生成或拼接圖像形成視圖,以補充駕駛員的視覺盲點,而不涉及車輛控制,因此越來越重視視頻處理,技術已經成熟并逐步普及。

目前,在駕駛輔助功能中,攝像頭可以獨立實現許多功能,并根據自動駕駛的發展規律逐步進化。

這些功能更加強調對輸入圖像的處理,從拍攝的視頻流中提取有效的目標運動信息進行進一步分析,給出預警信息或直接調動控制機制。與視頻輸出功能相比,它強調高速下的實時性能,這部分技術正處于發展的上升期。

第二,視覺ADAS的軟硬件要求

視覺系統ADAS產品由軟件和硬件組成,主要包括攝像頭模塊、核心算法芯片和軟件算法。在硬件方面,應考慮駕駛環境(振動、高低溫等),大前提是滿足車輛法規的要求。

(1) 車載ADAS攝像頭模塊

車載ADAS攝像頭模塊需要定制化開發。為了滿足全天候車輛的需求,當明暗對比度太大(進出隧道)時,通常需要平衡圖像中太亮或太暗(寬動態)的部分。對光敏感(高靈敏度),避免給芯片帶來太大壓力(不要盲目追求高像素)。

攝像頭模塊是基礎。就像一張有著良好基礎的照片一樣,也有美化的空間。在保證拍攝到的圖像足夠的基礎上,該算法可以更好地發揮作用。

此外,在參數方面,ADAS和行車記錄儀對攝像頭有不同的要求。用于行車記錄儀的攝像頭需要看到汽車前部周圍盡可能多的環境信息(后視鏡看著兩個前輪,水平視角約為110度)。ADAS的攝像頭更注重為駕駛預留更多的判斷時間,需要看得更遠。與相機鏡頭的廣角和長焦類似,這兩個參數不可能同時存在,ADAS只能在選擇硬件時進行平衡。

(2) 核心算法芯片

圖像相關算法對計算資源的要求很高,因此芯片的性能也很特殊。如果在算法上疊加深度學習來幫助提高識別率,那么對硬件性能的要求只會增加,主要性能指標是操作速度、功耗和成本。

目前,ADAS相機中使用的芯片大多被外國壟斷,主要供應商有瑞薩電子、ST微電子(ST)、自由規模、雅德諾(ASIC)、德州儀器(TI)、恩智浦、富士通、賽靈思、英偉達等。

ARM、DSP、ASIC、MCU和SOC是軟件編程的嵌入式方案。與嵌入式系統相比,FPGA具有更快的處理速度,因為它直接對硬件進行編程。

GPU和FPGA具有較強的并行處理能力。對于圖片之類的文本,尤其是在使用深度學習算法時,需要多個像素同時計算,FPGA和GPU將具有更多優勢。這兩種芯片的設計思想相似,都是為了處理大量簡單重復的操作而設計的。GPU的性能更強,但能耗更高。由于FPGA的編程和優化是直接在硬件層面進行的,因此能耗會低得多。

因此,FPGA被認為是一種流行的平衡算法和處理速度的方案,尤其是當它用于預安裝并且算法穩定時。FPGA是一個不錯的選擇。但與此同時,FPGA的技術要求也很高。原因是計算機視覺算法是用C語言編寫的,FPGA硬件語言是verilog。這兩種語言是不同的,所以將算法移植到FPGA的人應該有軟件背景和硬件背景。在人才最昂貴的今天,這是一個不小的成本。

目前,可以在傳統的計算機視覺算法中使用的車規芯片有很多選擇,但低功耗和……

適用于傳統算法和深度學習算法的高性能芯片并沒有真正出現。

(3) 算法

ADAS視覺算法的來源是計算機視覺。

傳統的物體計算機視覺識別大致可以分為幾個步驟:圖像輸入、預處理、特征提取、特征分類、匹配和完全識別。

有兩個特殊的地方依賴于專業經驗:第一個是特征提取。識別障礙物時有許多可用的功能,功能設計尤其重要。要判斷前方的障礙物是否是汽車,參考特征可能是汽車的尾燈,也可能是汽車底盤在地面上投射的陰影。二是預處理和后處理。預處理包括輸入圖像的噪聲平滑、對比度增強和邊緣檢測。后處理是指對分類和識別結果候選者進行后處理。

科學研究中的計算機視覺算法模型在應用于實際環境時可能表現不佳。由于科學研究獲得的算法會增加天氣、復雜路況等條件,在現實世界中,除了要注意算法在復雜環境中的性能外,還要考慮算法在各種環境中的魯棒性(穩定性)。

算法的一個重要變化是深度學習的滲透。

深度學習使計算機能夠模擬人類思維的神經網絡,并能夠自行學習和判斷。通過將校準后的原始數據直接輸入計算機,例如選擇一堆異形汽車的圖片,然后將其扔到計算機中,它可以自己學習汽車是什么。這樣,可以省去計算視覺特征提取和預處理的步驟,將感知過程簡化為輸入圖片和輸出結果兩個步驟。

業內一致認為,在感知方面,深度學習將在角落里超越傳統的視覺算法。目前,深度學習的算法模型已經開源,算法種類不多,因此有可能降低閾值,并產生大量優秀的結果。然而,由于缺乏合適的汽車平臺,距離商業化還有很長的路要走。

業界對深度學習在ADAS中的應用的看法是客觀而冷靜的。許多人認為深度學習算法是Blackbox算法,類似于人類感知決策的過程,可以快速輸出結果,因此很難在事故發生后檢查原因。因此,在使用深度學習時應添加理性決策,并將設計劃分為多個塊。

還有一種觀點認為,傳統的計算機視覺算法比我們想象的更智能,它也可以在不斷尋找車輛圖片異同的過程中檢測到一些異形車輛。并且在疊加深度學習算法后,傳統的計算機視覺算法也可以幫助減少深度學習神經網絡的層數,簡化算法。

可以肯定的是,無論哪種算法,數據都是訓練和測試的寶貴資源,而且不是簡單地說越多越好,而是越有效越好(符合實際的汽車環境并確保多樣化)。

(4) 不同的攝像機平臺

單眼和雙目

為了完成ADAS任務,視覺方案通常需要實現兩項任務:測距(車輛與前方障礙物之間的距離)和識別(障礙物是什么)。根據汽車攝像頭模塊的不同,目前主流的ADAS攝像頭可以分為單眼和雙目兩種技術路線。

單眼相機的算法思想是先識別后測距:首先通過圖像匹配進行識別,然后根據圖像大小和高度進一步估計障礙物和車輛時間。在識別和估計階段,有必要與已建立的樣本數據庫進行比較。如果你想識別各種汽車,你需要建立一個車型數據庫,如果你想鑒定麋鹿,你需要創建一個麋鹿數據庫。

雙目攝像機的算法是先測距后識別:首先,通過視差直接測量物體和汽車之間的距離,原理與人眼相似。當兩只眼睛看著同一物體時……

t、 會有視差,也就是說,當他們閉上左眼和右眼看物體時,他們會發現感覺位移。這種位移可以進一步測量目標物體的距離。然后,在識別階段,雙目仍然需要使用與單眼相同的特征提取和深度學習算法來進一步識別障礙物。

因為視差越遠,視差就越小。業內有觀點認為,雙目在20米以內具有明顯的測距優勢,在20米以外很難減少視差測距。我們可以使用高像素相機和更好的算法來提高測距性能,這是難點和核心競爭力。

雙目透鏡間距和距離測量是兩個權衡參數。透鏡間距越小,檢測距離越近,透鏡間距越大,檢測距離就越遠。考慮到汽車的美觀性和ADAS的需求,小型遠程雙目產品更受歡迎。

由于增加一個鏡頭會帶來更多的計算量,因此整個相機模塊的性能要求和成本都更高。此外,在兩者的校準工作中,雙目比單眼更為復雜。

此外,選擇雙目方案切入市場并不能完全繞過單眼方案的難度。在第二階段,您仍然需要一個龐大的數據庫并完善算法。

單眼對比

多攝像頭方案

除了一臺雙目望遠鏡外,還有一個由多臺攝像機組成的平臺。在一些方案中,選擇長焦和廣角相機與ADAS主相機配合,兼顧周圍環境和遠處物體檢測。例如,Mobileye方案將在下面介紹。

也有ADAS功能疊加在全景平臺上的情況。例如,對于環視進行車道偏離警告(LDW),與單目實現該功能相比,它具有一定的優勢。在大雨或前方光源強的情況下,前視攝像頭可能看不清車道線,攝像頭可以斜向下看車道線并提供多個角度,基本不受地面水反射的影響,其功能可以比前視攝像頭更穩定。但同時,我們也要考慮在側面沒有大燈的情況下攝像頭的夜間表現。

這些方案與單眼在技術路線上沒有本質區別。它們更多地基于不同的平臺,充分發揮不同類型相機模塊的優勢來分配任務,或者提供更多的視角來解決單眼在一些復雜環境中較弱的情況。

第三,視覺系統ADAS產品測試與評估

目前,還沒有統一的ADAS測試和評估標準。常規測試通常分為兩個階段:

在算法庫測試中,庫中包含了在各種工況下采集的駕駛場景視頻,并利用庫中的場景視頻測試算法識別率。目前,測試庫由每家公司自行測試,因為集合中使用的傳感器不同,不同企業的測試結果也不具有可比性。

KITTI由德國卡爾斯魯厄理工學院和芝加哥豐田理工學院共同創立,是一個國際權威的機動車輔助駕駛應用技術評估算法評估平臺。目前,一些公司在這個網站上測試算法,結果是公開的。不同公司的運行時間存在差異,因此我們在查看結果排名時不能忽視多個參數的比較。

在實車測試階段,將產品DEMO安裝在車內進行測試,并根據漏報和誤報判斷算法的可靠性,對發現的問題進行反復調試。目前,高質量的實車測試大多由主機廠和零部件供應商控制。精確測量需要激光雷達等設備的幫助,在相互驗證的過程中完成測量,成本略高,測試周期略長。

據業內人士介紹,算法庫測試更多的是用來測試產品70-90分的能力,而實車quan……

當差值為90-95分或甚至95-98分時,必須進行權威測試。目前,ADAS家庭之間的差距在于將分數從90分提高到99分。為了做到這一點,我們必須做大量的實際道路測試,并打磨算法的準確性和穩健性。因此,在某種程度上,在OEM中經歷過Tier1嚴格培訓的解決方案提供商具有更高的產品可靠性,預安裝經驗將成為下一次合作談判的資本。

目前,企業聲稱衡量算法能力的“識別率”指標不能說完全沒有參考價值。前提是,所謂的識別率應該在不同的復雜場景下進行評估,單獨談論識別率指數是沒有意義的,因此需要與其他指標一起考慮。該產品必須確保算法能夠在不同的路況、天氣、車輛類型、不同姿勢的人和不同的車道線下穩定(穩健)工作。

第四,兄弟Mobileye

視聽部門ADAS不得不提到一家以色列公司Mobileye,該公司成立于1999年,2007年推出了第一款產品,并于2014年8月1日在紐約證券交易所上市。公司主要從事汽車行業計算機視覺算法和駕駛員輔助系統芯片技術的研究。Mobileye的產品覆蓋全球50個國家。根據官方數據,截至2015年底,Mobileye的全球裝載能力為1000萬,到2016年底將有273份SOP合同。

(A) 公司定位

在預裝配業務中,這家以色列公司作為二級部件供應商向Tier1提供產品,與車輛應用相關的零部件將與OEM合作。通過一線供應商提供集成、個性化開發和測試。安裝完成后,采用代理銷售的方式。

(2) 產品功能

目前,安裝在后視鏡后面的單色攝像頭(非標準RGB傳感器)可以用于檢測、識別和分類目標,同時可以跟蹤和分析物體的運動軌跡,分析路況。功能包括車道檢測、車輛檢測、行人檢測、動物檢測、交通標志識別、紅綠燈識別和燈光控制。

Mobileye擁有自主研發和設計的芯片EyeQ系列,由STM微電子公司生產和供應。目前已經大規模生產的芯片型號包括EyeQ1、EyeQ2和EyeQ3。EyeQ4正在開發中,預計將于2018年推出,其工程樣品預計將于2016年第四季度發布。2016年5月,Mobileye宣布將與STF合作開發用于自動駕駛的下一代EyeQ5芯片,并于2018年開始提供工程樣品。

目前,Mobileye的后裝產品終端價格在8000元左右,前裝價格會低很多。

Mobileye的不同芯片可以實現不同的ADAS功能。其中,EYEQ2支持產品級AEB,EyeQ3支持完整的AEB。EyeQ2只能實現ASIL-B,而EyeQ3可以實現ASIL-D。。(ASIL,汽車安全集成級別,是ISO26262中系統危險風險級別的指標,產品的安全級別從A依次增加到D。)

Mobileye EyeQ1-EyeQ3產品地圖

2007年,沃爾沃實現了攝像頭+雷達一體化防撞預警功能。(眼睛Q1)

2008年,寶馬實現了單攝像頭車道偏離預警和交通標志識別。(眼睛Q1)

2010年,沃爾沃實現了行人碰撞檢測,AEB是第一個行人檢測。(眼睛Q2)

在寶馬、通用和歐寶上,一個攝像頭被用來跟蹤擁堵車道上的汽車。(眼睛Q2)

2013年,寶馬和日產使用了攝像頭來實現AEB功能(部分)。(眼睛Q2)

寶馬大規模生產的基于攝像頭的自適應巡航(ACC)和交通堵塞助手(Traffic Jam Assistant)是通過使用EYEQ2實現的。(眼睛Q2)

2015年,奧迪實現了基于攝像頭的全AEB功能。(眼睛Q3)

在特斯拉模型上實現交通檢測,并通過深度神經網絡判斷自由空間和路徑規劃。(眼睛Q3)

在Mobileye過去的演講和介紹中,提到了前車識別算法的一些細節:

從車輛識別的角度來看,單目識別通常有兩種算法……

預測,一個是THW(Time Headway),另一個是TTC(Time to Collision)。在THW計算公式中,時間t=兩輛車之間的距離/車輛的速度;在TTC公式中,時間t'=車輛距離/兩輛車的相對速度。TTC對計算有更高的要求,因為除了車輛的速度外,還應該實時測量前一輛車的速度。計算方法是估計兩輛車之間的距離和它們自身的速度。

Mobileye在不同的場景中使用了兩種算法。

TTC用于前方碰撞檢測(FCW),尤其是在高速行駛時在汽車前方突然制動的情況下。可以清楚地發現,TTC的算法更符合實際情況。Mobileye檢測規劃路徑前后的車輛(不僅僅是識別該車道上的車輛),并利用圖像的變化速度進行TTC,從而判斷碰撞的可能性,并采取干預、控制和制動控制。

目前,Mobileye售后產品的TTC時間設定為2.7秒,官方FCW準確度約為99.99%。對于前裝,TTC是為該車道上離車輛最近的車輛計算的,AEB通常在1秒的間隔內工作。

Mobileye采用THW算法,在未來的控制下,它可以使用單個攝像頭作為ACC或低速交通堵塞助手。目前,這兩項功能都是由市場上的毫米波雷達實現的。如果使用攝像頭,它可以集成視覺檢測到的車道、靜態障礙物、車輛的橫向運動和限速標志,并匯總多個信息來做出ACC決策,控制將更加準確。

Mobileye售后市場產品的THW時間設置可以從2.5秒到0.1秒。

(3) 自動駕駛規劃

關于如何實現自動駕駛,Mobileye將涉及感知、地圖和駕駛策略三個方面。

在感知方面,根據Mobileye的計劃,在不考慮冗余的情況下,需要8個攝像頭來滿足360度全方位感知的需求。2015年,Mobileye發布了三款攝像頭來實現ADAS功能。這三個攝像頭有不同的分工:中間的主攝像頭可以實現大多數功能,檢測距離可以達到150米,檢測后跟蹤距離可以達到250米。另一個小角度相機可以檢測更長的距離,而廣角鏡頭可以檢測更寬的視野。

該算法主要實現四個內容,對深度學習的要求逐項增加:

1.識別道路上的移動/固定物體;

2.識別道路分界線和其他交通標志;

3.當道路上沒有分界線或分界線不清晰時,區分哪些空間可以通過,并劃出通過空間與其他部分的分隔線;

4.可行駛路徑:確定可通行空間后,找到行駛路線。

地圖是感知系統的冗余設計,包括路標、高精度定位和可行駛路徑三個方面。Mobileye打算通過具有深度學習功能的圖像識別系統制作高精度地圖。數據采集將與汽車公司合作,通過眾包方式獲取和更新數據。

在駕駛策略方面,車企可以通過提供的SDK訪問Mobileye預先訓練的網絡應用層,使控制單元能夠快速計算并獲得可行的路徑方案。他們將在車企提供的算法基礎上,結合自己在車輛控制方面的經驗進行優化或重新開發。該功能將在Eye的基礎上實現。

Mobileye計劃在2016年推出半自動汽車技術。即將開發的系統可以讓汽車讀取各種交通和街道信號,從而與其他車輛保持適當的距離。大眾、寶馬和通用汽車購買了2018年生產的系統,該系統使車輛能夠高速自動駕駛。2016年5月,Mobileye和兩家保密汽車公司達成協議,將在2019年為后者提供全自動駕駛汽車系統。

2016年7月,Mobileye與寶馬、英特爾共同開發無人駕駛汽車技術。2016年8月,宣布將與德爾福汽車公司共同開發一套完整的SAE(美國汽車工程協會)4/5自動駕駛解決方案。

(四) 團隊簡介

創始人之一是耶路撒冷希伯來大學的計算機科學教授Amnon Shashua。Mobileye在美國、德國、日本和西班牙也有分支機構或研究部門。現在,公司有600多名員工,研發人員占70%-80%。目前,中國只有一個售后團隊,辦公室位于上海,沒有研發人員。

(五) 投資和融資

2006年5月,它獲得了1500美元的投資。

2007年10月,高盛投資了1億美元。

2013年7月,Mobileye向五家獨立金融投資者出售了4億股股票。投資者包括黑石集團(Blackstone)、富達集團(Fidelity)、威靈頓集團(Wellinton)、恩特汽車租賃公司(Ente Car Rental Company)和中國投資公司帆船國際投資基金(China Investment Company Sailing International Investment Fund)。除現金外,這筆交易對Mobileye的估值為15億美元。

相關閱讀:

ADAS視覺解決方案盤點第二部分:對11家初創公司的完整解讀Mobileye的產品覆蓋全球50個國家。根據官方數據,截至2015年底,Mobileye的全球裝載能力為1000萬,到2016年底將有273份SOP合同。

(A) 公司定位

在預裝配業務中,這家以色列公司作為二級部件供應商向Tier1提供產品,與車輛應用相關的零部件將與OEM合作。通過一線供應商提供集成、個性化開發和測試。安裝完成后,采用代理銷售的方式。

(2) 產品功能

目前,安裝在后視鏡后面的單色攝像頭(非標準RGB傳感器)可以用于檢測、識別和分類目標,同時可以跟蹤和分析物體的運動軌跡,分析路況。功能包括車道檢測、車輛檢測、行人檢測、動物檢測、交通標志識別、紅綠燈識別和燈光控制。

Mobileye擁有自主研發和設計的芯片EyeQ系列,由STM微電子公司生產和供應。目前已經大規模生產的芯片型號包括EyeQ1、EyeQ2和EyeQ3。EyeQ4正在開發中,預計將于2018年推出,其工程樣品預計將于2016年第四季度發布。2016年5月,Mobileye宣布將與STF合作開發用于自動駕駛的下一代EyeQ5芯片,并于2018年開始提供工程樣品。

目前,Mobileye的后裝產品終端價格在8000元左右,前裝價格會低很多。

Mobileye的不同芯片可以實現不同的ADAS功能。其中,EYEQ2支持產品級AEB,EyeQ3支持完整的AEB。EyeQ2只能實現ASIL-B,而EyeQ3可以實現ASIL-D。。(ASIL,汽車安全集成級別,是ISO26262中系統危險風險級別的指標,產品的安全級別從A依次增加到D。)

Mobileye EyeQ1 Ey……

3產品地圖

2007年,沃爾沃實現了攝像頭+雷達一體化防撞預警功能。(眼睛Q1)

2008年,寶馬實現了單攝像頭車道偏離預警和交通標志識別。(眼睛Q1)

2010年,沃爾沃實現了行人碰撞檢測,AEB是第一個行人檢測。(眼睛Q2)

在寶馬、通用和歐寶上,一個攝像頭被用來跟蹤擁堵車道上的汽車。(眼睛Q2)

2013年,寶馬和日產使用了攝像頭來實現AEB功能(部分)。(眼睛Q2)

寶馬大規模生產的基于攝像頭的自適應巡航(ACC)和交通堵塞助手(Traffic Jam Assistant)是通過使用EYEQ2實現的。(眼睛Q2)

2015年,奧迪實現了基于攝像頭的全AEB功能。(眼睛Q3)

在特斯拉模型上實現交通檢測,并通過深度神經網絡判斷自由空間和路徑規劃。(眼睛Q3)

在Mobileye過去的演講和介紹中,提到了前車識別算法的一些細節:

從車輛識別的角度來看,單目預測通常有兩種算法,一種是THW(Time Headway),另一種是TTC(Time to Collision)。在THW計算公式中,時間t=兩輛車之間的距離/車輛的速度;在TTC公式中,時間t'=車輛距離/兩輛車的相對速度。TTC對計算有更高的要求,因為除了車輛的速度外,還應該實時測量前一輛車的速度。計算方法是估計兩輛車之間的距離和它們自身的速度。

Mobileye在不同的場景中使用了兩種算法。

TTC用于前方碰撞檢測(FCW),尤其是在高速行駛時在汽車前方突然制動的情況下。可以清楚地發現,TTC的算法更符合實際情況。Mobileye檢測規劃路徑前后的車輛(不僅僅是識別該車道上的車輛),并利用圖像的變化速度進行TTC,從而判斷碰撞的可能性,并采取干預、控制和制動控制。

目前,Mobileye售后產品的TTC時間設定為2.7秒,官方FCW準確度約為99.99%。對于前裝,TTC是為該車道上離車輛最近的車輛計算的,AEB通常在1秒的間隔內工作。

Mobileye采用THW算法,在未來的控制下,它可以使用單個攝像頭作為ACC或低速交通堵塞助手。目前,這兩項功能都是由市場上的毫米波雷達實現的。如果使用攝像頭,它可以集成視覺檢測到的車道、靜態障礙物、車輛的橫向運動和限速標志,并匯總多個信息來做出ACC決策,控制將更加準確。

Mobileye售后市場產品的THW時間設置可以從2.5秒到0.1秒。

(3) 自動駕駛規劃

關于如何實現自動駕駛,Mobileye將涉及感知、地圖和駕駛策略三個方面。

在感知方面,根據Mobileye的計劃,在不考慮冗余的情況下,需要8個攝像頭來滿足360度全方位感知的需求。2015年,Mobileye發布了三款攝像頭來實現ADAS功能。這三個攝像頭有不同的分工:中間的主攝像頭可以實現大多數功能,檢測距離可以達到150米,檢測后跟蹤距離可以達到250米。另一個小角度相機可以檢測更長的距離,而廣角鏡頭可以檢測更寬的視野。

該算法主要實現四個內容,對深度學習的要求逐項增加:

1.識別道路上的移動/固定物體;

2.識別道路分界線和其他交通標志;

3.當道路上沒有分界線或分界線不清晰時,區分哪些空間可以通過,并劃出通過空間與其他部分的分隔線;

4.可行駛路徑:確定可通行空間后,找到行駛路線。

地圖是感知系統的冗余設計,包括路標、高精度定位和可行駛路徑三個方面。Mobileye打算通過具有深度學習功能的圖像識別系統制作高精度地圖。數據采集將與汽車公司合作,通過眾包方式獲取和更新數據。

在駕駛策略方面,車企可以通過提供的SDK訪問Mobileye預先訓練的網絡應用層,使控制單元能夠快速計算并獲得可行的路徑方案。他們將在車企提供的算法基礎上,結合自己在車輛控制方面的經驗進行優化或重新開發。該功能將在Eye的基礎上實現。

Mobileye計劃在2016年推出半自動汽車技術。即將開發的系統可以讓汽車讀取各種交通和街道信號,從而與其他車輛保持適當的距離。大眾、寶馬和通用汽車購買了2018年生產的系統,該系統使車輛能夠高速自動駕駛。2016年5月,Mobileye和兩家保密汽車公司達成協議,將在2019年為后者提供全自動駕駛汽車系統。

2016年7月,Mobileye與寶馬、英特爾共同開發無人駕駛汽車技術。2016年8月,宣布將與德爾福汽車公司共同開發一套完整的SAE(美國汽車工程協會)4/5自動駕駛解決方案。

(四) 團隊簡介

創始人之一是耶路撒冷希伯來大學的計算機科學教授Amnon Shashua。Mobileye在美國、德國、日本和西班牙也有分支機構或研究部門。現在,公司有600多名員工,研發人員占70%-80%。目前,中國只有一個售后團隊,辦公室位于上海,沒有研發人員。

(五) 投資和融資

2006年5月,它獲得了1500美元的投資。

2007年10月,高盛投資了1億美元。

2013年7月,Mobileye向五家獨立金融投資者出售了4億股股票。投資者包括黑石集團(Blackstone)、富達集團(Fidelity)、威靈頓集團(Wellinton)、恩特汽車租賃公司(Ente Car Rental Company)和中國投資公司帆船國際投資基金(China Investment Company Sailing International Investment Fund)。除現金外,這筆交易對Mobileye的估值為15億美元。

相關閱讀:

ADAS視覺解決方案盤點第二部分:11家初創公司的完整解讀

第一電動研究院行業報告與數據由第一電動研究院出品,每月更新發布。

1900/1/1 0:00:00在上篇中,我們盤點了視覺ADAS可以實現的功能、軟硬件需求、以及測試評價方法。一哥Mobileye受人尊敬,也是不少國內創業公司爭相趕超的對象。

1900/1/1 0:00:00Si負極材料是目前唯一實現商業化應用的新型負極材料,純硅負極材料在完全充電的狀態下比容量可以達到4200mAhg,遠高于傳統的石墨負極材料。

1900/1/1 0:00:00在北京持續限購、限行的大政策背景下,傳統燃油車的號牌成極度稀缺資源。而隨著北京市對新能源汽車的不搖號、不限行等政策優待,新能源汽車的號牌資源也正在走向稀缺。

1900/1/1 0:00:002016年10月23日,囊括江淮汽車建設的年產10萬臺新能源汽車項目在內,合肥經開區19個重大項目集中開工儀式在合肥空港經濟示范區舉行。

1900/1/1 0:00:00Note7手機的頻頻爆炸事件,讓全世界人民都對三星電池的安全性心有余悸,甚至相關手機機型都被各國禁止使用。在中國汽車圈,正準備大展拳腳的三星電池,如今的日子也并不好過。

1900/1/1 0:00:00