據《商業內幕》網站報道,專家表示,自動駕駛汽車在“誰的生命更有價值”的問題上做出了深遠的選擇。因此,人們希望關注自己的選擇。麻省理工學院的認知科學家Iyad Rahwan在一封電子郵件中寫道,“每次自動駕駛汽車做出避讓動作時,它都會秘密地決定不同群體的危險程度。”

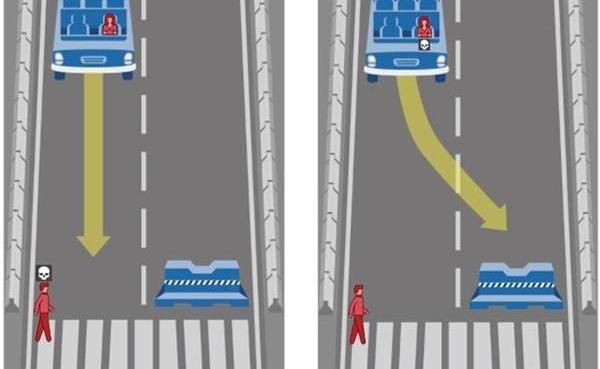

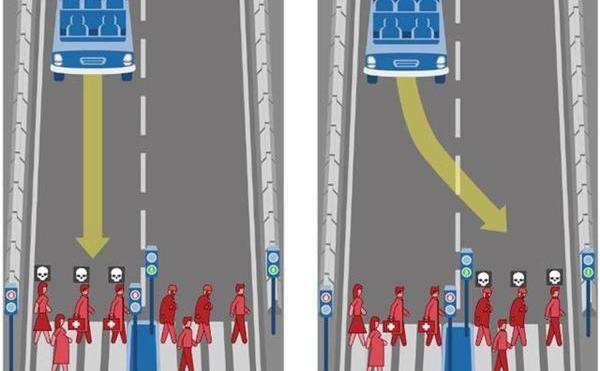

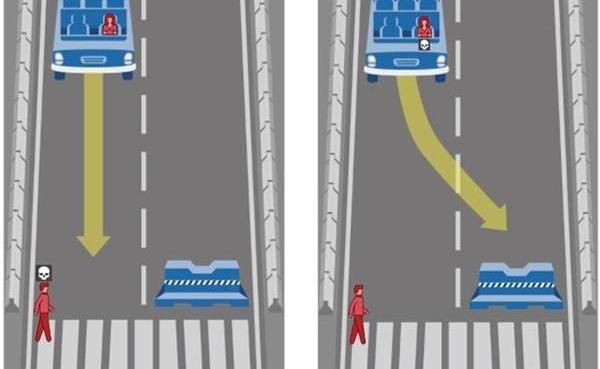

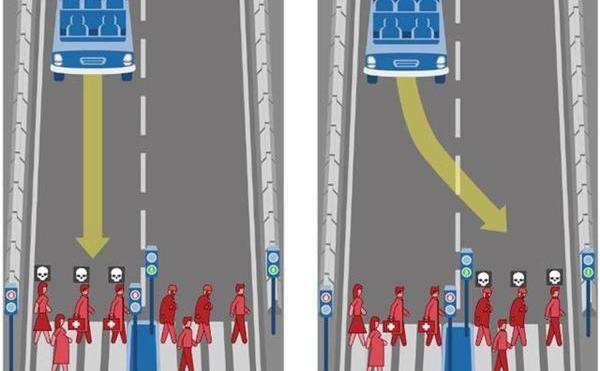

在關于自動駕駛汽車倫理的討論中,最著名的問題是電車問題——倫理學領域最著名的思想實驗之一,它意味著在不可避免的交通事故中應該犧牲誰。例如,如果一名行人突然摔倒在一輛快速行駛的自動駕駛汽車前面,汽車可能會改變方向并撞上路障,這可能會導致乘客死亡,或者繼續向前行駛,這可能導致摔倒在地的行人死亡。自動駕駛汽車應該做什么?拉萬和他的同事研究了人們在沒有完全解決方案的情況下如何選擇的問題。盡管死亡現場目前只是一個假設,但Lavan和其他業內人士表示,在自動駕駛汽車流行之后,這種情況是不可避免的。

日常生活中也存在倫理問題。例如,自動駕駛汽車在經過騎自行車的人或行人時應該做什么?

加州州立理工大學哲學教授Ryan Jenkins說,“在路上開車時,會給周圍的人帶來危險。當開車經過騎自行車和慢跑的人時,我們會盡量遠離他們,因為我們認為這樣更安全。即使我們非常有信心不會與他們相撞,我們也會認為意想不到的事情會迫使我們撞向方向,或者騎自行車的人會從自行車上摔下來,慢跑的人會在路上滑倒。”

回答這些問題并不容易。弗吉尼亞州交通研究委員會的科學家諾亞·古德爾在一封電子郵件中寫道,“為了真正確保行人的安全,當人行道上有行人時,自動駕駛汽車的速度應該非常低,以防行人在高速公路上行走。”

人類駕駛員可以直觀地回答各種倫理問題,這對人工智能來說不是一個簡單的問題。自動駕駛汽車程序員必須為每種情況制定明確的規則,或者依靠通用的駕駛規則來解決問題。

拉萬寫道,“一方面,控制自動駕駛汽車的算法可能有一套明確的規則來進行道德權衡;

另一方面,自動駕駛汽車在不可避免的傷害情況下做出的決定可能來自多個軟件元素的交互,沒有任何軟件元素專門負責處理道德決策。"

《商業內幕》表示,即使程序員選擇保持模糊,在某些情況下或一般情況下,自動駕駛汽車的行為模式仍然可以追溯。艾倫人工智能學會首席執行官奧倫·埃齊奧尼在一封電子郵件中寫道,“用著名神學家哈維·考克斯的話來說,沒有選擇就是選擇。”

自動駕駛汽車公司如何處理這些道德問題?在許多情況下,他們試圖避免這些問題。

盡管有軌電車問題引起了很多關注,但自動駕駛汽車行業基本上拒絕表達自己的觀點或不屑一顧。戴姆勒的一位高管今年秋天告訴《汽車與司機》,梅賽德斯-奔馳的自動駕駛汽車將不惜一切代價保護乘客。戴姆勒后來否認了這一說法,稱“顯然,無論是程序員還是自動駕駛系統都沒有資格決定人類生命的價值”。戴姆勒還表示,有軌電車問題并不是一個真正的問題,因為該公司“致力于通過實施能夠預防風險的駕駛策略來徹底避免困境”。

當然,倫理學家會指出,一些風險是不可避免的,比如剎車失靈以及其他司機、騎自行車的人、行人和動物的突然和不可預測的行為。因此,認為汽車必須做出艱難的選擇并不虛偽。對于戴姆勒關于所有生命都是平等的說法,我們可以認為這意味著它沒有明確地認為哪一組人更有價值。

在自動駕駛汽車如何應對交通事故方面,谷歌披露的細節比其他公司更多。

2014年,谷歌X部門創始人Sebastian Thrun表示,該公司的自動駕駛汽車將選擇與兩個物體中較小的一個碰撞。“如果交通事故不可避免,它會撞到一個較小的物體。”

2014年,谷歌的一項關于橫向車道位置的專利遵循了類似的邏輯,描述了自動駕駛汽車應該遠離一條車道上的卡車,靠近另一條車道的汽車,因為與較小的物體碰撞更安全。

當然,與較小物體相撞是一種合乎道德的選擇:這樣的選擇可以保護乘客的利益,并將他們所遭受的傷害降至最低。這也將被視為將危險傳遞給行人或乘坐小型汽車的乘客。正如加州州立理工大學哲學教授Patrick Lin在一封電子郵件中指出的那樣,“較小的物體可能是嬰兒車或兒童。”

2016年3月,時任谷歌自動駕駛汽車團隊負責人的Chris Urmson向《洛杉磯時報》描述了一條更“復雜”的規則:“我們的自動駕駛汽車將盡最大努力避免撞到未受保護的道路使用者:騎自行車的人和行人,他們也將避免撞到移動物體。”

與擊打較小的物體相比,這種方法更注重實用性,并盡最大努力保護可能在事故中受到最大傷害的人。當然,它可能不會受到自動駕駛汽車購買者的青睞,他們當然希望自己購買的汽車能夠不惜一切代價保護自己。如何處理自動駕駛汽車的道德問題?業內至少有一個共識:這個問題需要更多的討論。

美國國家公路交通安全管理局9月發布了一份報告,稱“制造商和其他機構正在與監管機構和其他利益相關者(如司機、乘客和弱勢道路使用者)合作,以應對這些情況,并確保有意識地做出此類道德判斷和決定。”

非營利消費者權益保護機構“消費者監督”的高管韋恩·辛普森也同意這一觀點。在提交給美國國家公路交通安全管理局的證詞中,他說,“公眾有權知道自動駕駛汽車在街上行駛時是否優先保護乘客、司機或行人的安全,以及考慮了哪些因素。如果這些問題無法解決,企業在設計汽車時會限制自己的責任,而不是遵守社會習俗、道德習慣或相關法律法規。“自動駕駛汽車行業似乎是一個“好建議”。知名自動駕駛汽車公司蘋果表示,將進行“深思熟慮的探索,并吸收行業領袖、消費者、聯邦機構和其他專家的反饋”。福特也表達了同樣的觀點,稱其一直在“合作……

與幾所知名大學和行業合作伙伴合作”,解決自動駕駛汽車的道德問題。

與此同時,福特還警告不要過度的哲學思考。福特汽車安全全球主管Wayne Bahr表示, “我們正試圖從專業的角度解決這個問題,避免陷入不切實際的假設。在關于自動駕駛汽車倫理的討論中,一個常見的問題是,對自動駕駛汽車能力的基本假設是錯誤的。例如,質疑一個人的生命價值高于其他人的生命價值,假設自動駕駛汽車可以區分誰具有更高的價值。"

據《商業內幕》報道,巴謝爾的評論提到了電車謎題的其他版本:在選擇殺死誰時,要考慮他們的年齡、法律地位、社會價值和其他因素。從短期來看,自動駕駛汽車不可能根據這些因素將人分為三類或六類。

從長遠來看,最合乎道德的決定是讓大多數在路上行駛的汽車變成自動駕駛汽車。畢竟,自動駕駛汽車比人類駕駛員安全得多,預計它們可以將交通事故減少90%。

然而,自動駕駛汽車的普及需要良好的法律來避免可能引發爭議和訴訟的錯誤。換句話說,這需要道德標準。

Lavan和他的同事Azim Shariff和Jean-Fran?ois Bonnefon在《紐約時報》上寫道,“自動駕駛汽車越早普及,在交通事故中死亡的人就越少。然而,要把人們從駕駛汽車中解放出來,就必須認真解決自動駕駛汽車的心理和技術挑戰。”據《商業內幕》網站報道,專家表示,自動駕駛汽車在“誰的生命更有價值”的問題上做出了意義深遠的選擇。因此,人們希望關注自己的選擇。麻省理工學院的認知科學家Iyad Rahwan在一封電子郵件中寫道,“每次自動駕駛汽車做出避讓動作時,它都會秘密地決定不同群體的危險程度。”

在關于自動駕駛汽車倫理的討論中,最著名的問題是電車問題——倫理學領域最著名的思想實驗之一,它意味著在不可避免的交通事故中應該犧牲誰。例如,如果一名行人突然摔倒在一輛快速行駛的自動駕駛汽車前面,汽車可能會改變方向并撞上路障,這可能會導致乘客死亡,或者繼續向前行駛,這可能導致摔倒在地的行人死亡。自動駕駛汽車應該做什么?拉萬和他的同事研究了人們在沒有完全解決方案的情況下如何選擇的問題。盡管死亡現場目前只是一個假設,但Lavan和其他業內人士表示,在自動駕駛汽車流行之后,這種情況是不可避免的。

日常生活中也存在倫理問題。例如,自動駕駛汽車在經過騎自行車的人或行人時應該做什么?

加州州立理工大學哲學教授Ryan Jenkins說,“在路上開車時,會給周圍的人帶來危險。當開車經過騎自行車和慢跑的人時,我們會盡量遠離他們,因為我們認為這樣更安全。即使我們非常有信心不會與他們相撞,我們也會認為意想不到的事情會迫使我們撞向方向,或者騎自行車的人會從自行車上摔下來,慢跑的人會在路上滑倒。”

回答這些問題并不容易。弗吉尼亞州交通研究委員會的科學家諾亞·古德爾在一封電子郵件中寫道,“為了真正確保行人的安全,當人行道上有行人時,自動駕駛汽車的速度應該非常低,以防行人在高速公路上行走。”

人類駕駛員可以直觀地回答各種倫理問題,這對人工智能來說不是一個簡單的問題。自動駕駛汽車程序員必須為每種情況制定明確的規則,或者依靠通用的駕駛規則來解決問題。

拉萬寫道,“一方面,控制自動駕駛汽車的算法可能有一套明確的規則來進行道德權衡;

另一方面,自動駕駛汽車在不可避免的傷害情況下做出的決定可能來自多個軟件元素的交互,沒有任何軟件元素專門負責處理道德決策。"

《商業內幕》表示,即使程序員選擇保持模糊,在某些情況下或一般情況下,自動駕駛汽車的行為模式仍然可以追溯。艾倫人工智能學會首席執行官奧倫·埃齊奧尼在一封電子郵件中寫道,“用著名神學家哈維·考克斯的話來說,沒有選擇就是選擇。”

自動駕駛汽車公司如何處理這些道德問題?在許多情況下,他們試圖避免這些問題。

盡管有軌電車問題引起了很多關注,但自動駕駛汽車行業基本上拒絕表達自己的觀點或不屑一顧。戴姆勒的一位高管今年秋天告訴《汽車與司機》,梅賽德斯-奔馳的自動駕駛汽車將不惜一切代價保護乘客。戴姆勒后來否認了這一說法,稱“顯然,無論是程序員還是自動駕駛系統都沒有資格決定人類生命的價值”。戴姆勒還表示,有軌電車問題并不是一個真正的問題,因為該公司“致力于通過實施能夠預防風險的駕駛策略來徹底避免困境”。

當然,倫理學家會指出,一些風險是不可避免的,比如剎車失靈以及其他司機、騎自行車的人、行人和動物的突然和不可預測的行為。因此,認為汽車必須做出艱難的選擇并不虛偽。對于戴姆勒關于所有生命都是平等的說法,我們可以認為這意味著它沒有明確地認為哪一組人更有價值。

在自動駕駛汽車如何應對交通事故方面,谷歌披露的細節比其他公司更多。

2014年,谷歌X部門創始人Sebastian Thrun表示,該公司的自動駕駛汽車將選擇與兩個物體中較小的一個碰撞。“如果交通事故不可避免,它會撞到一個較小的物體。”

2014年,谷歌的一項關于橫向車道位置的專利遵循了類似的邏輯,描述了自動駕駛汽車應該遠離一條車道上的卡車,靠近另一條車道的汽車,因為與較小的物體碰撞更安全。

當然,與較小物體相撞是一種合乎道德的選擇:這樣的選擇可以保護乘客的利益,并將他們所遭受的傷害降至最低。這也將被視為將危險傳遞給行人或乘坐小型汽車的乘客。正如加州州立理工大學哲學教授Patrick Lin在一封電子郵件中指出的那樣,“較小的物體可能是嬰兒車或兒童。”

2016年3月,時任谷歌自動駕駛汽車團隊負責人的Chris Urmson向《洛杉磯時報》描述了一條更“復雜”的規則:“我們的自動駕駛汽車將盡最大努力避免撞到未受保護的道路使用者:騎自行車的人和行人,他們也將避免撞到移動物體。”

與擊打較小的物體相比,這種方法更注重實用性,并盡最大努力保護可能在事故中受到最大傷害的人。當然,它可能不會受到自動駕駛汽車購買者的青睞,他們當然希望自己購買的汽車能夠不惜一切代價保護自己。如何處理自動駕駛汽車的道德問題?業內至少有一個共識:這個問題需要更多的討論。

美國國家公路交通安全管理局9月發布了一份報告,稱“制造商和其他機構正在與監管機構和其他利益相關者(如司機、乘客和弱勢道路使用者)合作,以應對這些情況,并確保有意識地做出此類道德判斷和決定。”

非營利消費者權益保護機構“消費者監督”的高管韋恩·辛普森也同意這一觀點。在提交給美國國家公路交通安全管理局的證詞中,他說,“公眾有權知道自動駕駛汽車在街上行駛時是否優先保護乘客、司機或行人的安全,以及考慮了哪些因素。如果這些問題無法解決,企業在設計汽車時會限制自己的責任,而不是遵守社會習俗、道德習慣或相關法律法規。“自動駕駛汽車行業似乎是一個“好建議”。知名自動駕駛汽車公司蘋果表示,將進行“深思熟慮的探索,并吸收行業領袖、消費者、聯邦機構和其他專家的反饋”。福特也表達了同樣的觀點,稱其一直在“合作……

與幾所知名大學和行業合作伙伴合作”,解決自動駕駛汽車的道德問題。

與此同時,福特還警告不要過度的哲學思考。福特汽車安全全球主管Wayne Bahr表示, “我們正試圖從專業的角度解決這個問題,避免陷入不切實際的假設。在關于自動駕駛汽車倫理的討論中,一個常見的問題是,對自動駕駛汽車能力的基本假設是錯誤的。例如,質疑一個人的生命價值高于其他人的生命價值,假設自動駕駛汽車可以區分誰具有更高的價值。"

據《商業內幕》報道,巴謝爾的評論提到了電車謎題的其他版本:在選擇殺死誰時,要考慮他們的年齡、法律地位、社會價值和其他因素。從短期來看,自動駕駛汽車不可能根據這些因素將人分為三類或六類。

從長遠來看,最合乎道德的決定是讓大多數在路上行駛的汽車變成自動駕駛汽車。畢竟,自動駕駛汽車比人類駕駛員安全得多,預計它們可以將交通事故減少90%。

然而,自動駕駛汽車的普及需要良好的法律來避免可能引發爭議和訴訟的錯誤。換句話說,這需要道德標準。

Lavan和他的同事Azim Shariff和Jean-Fran?ois Bonnefon在《紐約時報》上寫道,“自動駕駛汽車越早普及,在交通事故中死亡的人就越少。然而,要把人們從駕駛汽車中解放出來,就必須認真解決自動駕駛汽車的心理和技術挑戰。”

日產曾在2016年7月發布了ProPILOT技術。日前,有海外媒體報道,日產新一代聆風將配備ProPILOT技術,并有望于2019年亮相。

1900/1/1 0:00:00近日,第一電動網獲得一份發改委、住建部、交通部和能源局12月30日發布的《關于統籌加快推進停車場與充電基礎設施一體化建設的通知》,通知表示,將以停車充電一體化為重點,

1900/1/1 0:00:002017年新年伊始,正當廈門再度迎來國內頂級馬拉松賽事,一場“金龍藍創蔚藍”的媒體交流體驗也在這座城市盛大拉開帷幕。

1900/1/1 0:00:00北京時間1月4日,美國的電動汽車初創企業FaradayFuture簡稱FF時隔一年第二次在拉斯維加斯舉辦發布會,正式發布首款量產車型FF91。

1900/1/1 0:00:002017年1月3日是浙江省重大項目統一開工的日子,而臺州分會場設在臺州灣循環經濟產業集聚區新吉奧基地。

1900/1/1 0:00:00據外媒報道,韓國政府近日發布消息稱將在明年將放寬對搭載高容量電池的電動車的補助限制,此舉將進一步擴大韓國長續航里程電動車的市場,其中包括引入特斯拉。

1900/1/1 0:00:00